Najbardziej niebezpieczne decyzje w obszarze bezpieczeństwa maszyn to te, które podejmuje się z przekonaniem, że sprawa została definitywnie rozwiązana.

W projekcie pojawia się zagrożenie. Ktoś proponuje szybkie działanie: dołóżmy osłonę, wstawmy kurtynę, zrealizujmy funkcję bezpieczeństwa w sterowaniu. Problem wydaje się zamknięty. W dokumentacji pojawia się środek ochronny, w tabeli oceny ryzyka wartość spada, wszyscy idą dalej.

A później okazuje się, że:

- ciężka osłona tworzy nową strefę zgniotu,

- blokada utrudnia dostęp do regulacji i prowokuje obchodzenie,

- urządzenie ochronne ustawiono bez realnej weryfikacji czasu zatrzymania,

- dodatkowy element w torze bezpieczeństwa zmienił dynamikę układu w sposób, którego nikt nie przeanalizował.

To nie są

błędy wynikające z ignorancji.

To są błędy wynikające z uproszczenia.

Środek ochronny jest zmianą konstrukcyjną. Zmienia geometrię maszyny, dostępność przestrzeni, sposób obsługi, sekwencję działań przy zakłóceniu, zachowanie układu napędowego i reakcję sterowania. Każda taka zmiana wpływa na strukturę zagrożeń — czasem w sposób oczywisty, czasem bardzo subtelny.

W praktyce przemysłowej często obserwuje się myślenie liniowe: było zagrożenie A → dodaliśmy zabezpieczenie → zagrożenie A „zniknęło”. Tymczasem rzeczywistość jest nieliniowa. Zmiana w jednym miejscu potrafi przesunąć ryzyko w inne, mniej widoczne obszary.

I właśnie ten obszar — kiedy zabezpieczenie zamiast stabilizować układ, wprowadza nowe napięcia techniczne — wymaga chłodnej, inżynierskiej analizy.

Pierwszym błędem, który pojawia się po „dodaniu zabezpieczenia”, jest założenie, że zmiana ma charakter lokalny. Że dotyczy tylko jednego zagrożenia i nie wpływa na resztę układu.

W rzeczywistości każdy środek ochronny ingeruje w konstrukcję maszyny albo w jej sterowanie. A to oznacza, że ingeruje w:

- kinematykę,

- dostępność przestrzeni roboczej,

- czasy reakcji,

- sposób wykonywania czynności regulacyjnych i serwisowych,

- sposób reagowania na zakłócenia.

Jeżeli nie przeanalizuje się tych zmian całościowo, bardzo łatwo powstaje efekt przesunięcia ryzyka.

1. Osłona jako źródło nowych zagrożeń mechanicznych

Najbardziej klasyczny przykład to osłona mechaniczna. Jej funkcja jest oczywista: ograniczyć dostęp do strefy zagrożenia. I często robi to skutecznie.

Problem zaczyna się wtedy, gdy projekt skupia się wyłącznie na separacji, ignorując fizyczne właściwości samej osłony.

Ciężka

osłona uchylna to dodatkowa masa.

Dodatkowa masa to energia potencjalna.

Energia potencjalna to możliwość opadnięcia, zgniotu, uderzenia.

Jeżeli nie przeanalizowano toru ruchu osłony, sposobu jej podparcia oraz stabilności w położeniu otwartym i zamkniętym, środek ochronny staje się nowym elementem ruchomym w systemie. I generuje własne strefy zagrożenia.

W praktyce wygląda to banalnie: operator otwiera osłonę, trzyma ją jedną ręką, drugą sięga do środka, ktoś z boku ją potrąca. Albo zawias po roku eksploatacji zaczyna pracować z luzem. Wtedy osłona przestaje być „barierą”, a zaczyna być elementem dynamicznym.

To nie jest

marginalny przypadek.

To konsekwencja pominięcia faktu, że środek ochronny sam w sobie może być

źródłem energii i ruchu.

2. Urządzenie ochronne bez weryfikacji parametrów bezpieczeństwa

W praktyce bardzo często pojawia się schemat: montujemy kurtynę świetlną, wpinamy ją do sterownika bezpieczeństwa, ustawiamy odległość „zgodnie z katalogiem” i uznajemy temat za zamknięty.

Tyle że samo zastosowanie urządzenia ochronnego nie jest dowodem skutecznej redukcji ryzyka.

Aby mówić o rzeczywistej skuteczności, muszą być spełnione co najmniej trzy warunki techniczne.

a) Weryfikacja rzeczywistego czasu zatrzymania

Odległość urządzenia ochronnego od strefy zagrożenia nie może być przyjęta „z doświadczenia”. Musi wynikać z obliczeń zgodnych z ISO 13855, które opierają się na:

- rzeczywistym czasie zatrzymania maszyny (łącznie z bezwładnością układu),

- czasie reakcji urządzenia ochronnego i sterowania,

- czasie reakcji człowieka,

- stałych geometrycznych wynikających z typu urządzenia.

Kluczowe słowo: rzeczywisty.

Czas zatrzymania powinien być wyznaczony pomiarem w warunkach reprezentatywnych dla najgorszego przypadku: przy maksymalnym obciążeniu, przy najwyższej prędkości, z uwzględnieniem zmian w czasie (zużycie elementów hamujących, tolerancje, temperatura). Nie katalogowy. Nie deklarowany. Nie „typowy”.

Jeżeli tego pomiaru nie wykonano, nie ma dowodu, że dystans bezpieczeństwa został dobrany poprawnie. A bez poprawnego dystansu nie ma dowodu, że urządzenie ochronne realnie zapobiega dotarciu do strefy zagrożenia przed zatrzymaniem ruchu.

W takiej sytuacji zabezpieczenie może działać logicznie poprawnie, ale fizycznie nieskutecznie.

b) Weryfikacja funkcji bezpieczeństwa i Performance Level

Drugim elementem jest weryfikacja funkcji bezpieczeństwa zgodnie z ISO 13849-1.

Urządzenie ochronne jest tylko częścią łańcucha. Funkcja bezpieczeństwa obejmuje:

- czujnik (np. kurtynę),

- układ logiczny (sterownik bezpieczeństwa, przekaźniki),

- elementy wykonawcze (styczniki, zawory, napędy),

- strukturę architektury (kategoria),

- parametry niezawodnościowe (MTTFd, DC, CCF).

Jeżeli nie wykonano obliczeń Performance Level i nie wykazano, że osiągnięty PL ≥ wymagany PLr wynikający z oceny ryzyka, to formalnie nie ma potwierdzenia, że funkcja bezpieczeństwa spełnia wymagany poziom redukcji ryzyka.

Częstym

błędem jest założenie: „kurtyna ma PL e, więc jesteśmy bezpieczni”.

To nie kurtyna ma spełnić wymagany poziom.

To cała funkcja bezpieczeństwa musi go spełnić.

Jeżeli łańcuch zatrzymania zawiera element o zbyt niskiej niezawodności, pojedynczy stycznik bez monitorowania albo brakuje diagnostyki, rzeczywisty PL może być niższy od wymaganego. A wtedy skuteczność środka ochronnego jest założeniem, nie faktem.

c) Spójność funkcjonalna — nie tylko elektryczna

Trzeci obszar to integracja funkcji bezpieczeństwa z procesem technologicznym.

Nawet poprawnie obliczony dystans i prawidłowo zweryfikowany Performance Level nie gwarantują skuteczności, jeżeli:

- reset jest możliwy z pozycji umożliwiającej ponowny dostęp do strefy zagrożenia,

- ponowne uruchomienie następuje automatycznie po zwolnieniu urządzenia ochronnego,

- nie uwzględniono stanów przejściowych (np. ruchów resztkowych, bezwładności osi),

- nie zweryfikowano zachowania przy częściowej awarii systemu.

Funkcja bezpieczeństwa musi być nie tylko „podłączona”, ale logicznie poprawna i zweryfikowana w całym scenariuszu pracy maszyny.

Jeżeli którykolwiek z tych elementów (czas zatrzymania, dystans wg ISO 13855, PL/PLr wg ISO 13849-1, logika resetu i ponownego uruchomienia) nie został rzetelnie zweryfikowany, nie mamy potwierdzenia skutecznej redukcji ryzyka.

A problem jest głębszy.

W takiej sytuacji nie tylko nie udowodniono skuteczności środka ochronnego. Na tym etapie wprowadzamy nowe sytuacje zagrożenia. Operator dostaje sygnał, że przestrzeń jest chroniona. Zachowanie ulega zmianie — podejście jest szybsze, dystans mniejszy, reakcja bardziej zdecydowana. Jeżeli jednak rzeczywisty czas zatrzymania jest dłuższy niż przyjęto w projekcie, powstaje sytuacja, w której człowiek znajduje się w strefie oddziaływania zagrożenia zanim ruch niebezpieczny zostanie zatrzymany.

To jest normowa sytuacja zagrożenia: okoliczność, w której osoba jest narażona na co najmniej jedno zagrożenie.

Podobnie w przypadku niewłaściwie zweryfikowanego Performance Level: jeżeli funkcja bezpieczeństwa nie osiąga wymaganego PLr, to w warunkach pojedynczej awarii lub utraty diagnostyki może dojść do utraty funkcji zatrzymania. Wtedy mamy do czynienia z sytuacją, w której:

- zagrożenie nadal istnieje,

- człowiek zakłada jego redukcję,

- a system nie realizuje funkcji bezpieczeństwa zgodnie z założeniem.

To nie jest

„niepełna dokumentacja”.

To jest strukturalnie nowa sytuacja zagrożenia wprowadzona na etapie

projektowania.

3. Gdy zabezpieczenie zmienia sposób pracy — a wraz z nim strukturę ryzyka

Każdy środek ochronny zmienia nie tylko geometrię maszyny czy parametry zatrzymania. Zmienia również sposób wykonywania pracy.

To właśnie w tym miejscu bardzo często powstają nowe sytuacje zagrożenia — nie dlatego, że urządzenie ochronne „nie działa”, ale dlatego, że projekt nie przewidział, jak będzie używane w rzeczywistości.

a) Dostęp utrudniony = ingerencja improwizowana

Jeżeli osłona znacząco utrudnia dostęp do regulacji, czyszczenia lub przezbrojenia, operator zaczyna skracać procedury:

- pozostawia osłonę częściowo otwartą,

- blokuje wyłącznik krańcowy,

- wykonuje czynności przy ruchach resztkowych,

- ingeruje przy niepełnym zatrzymaniu.

To nie jest

problem „niezdyscyplinowanego pracownika”.

To jest efekt projektu, który nie uwzględnił realnej częstotliwości i

charakteru danego zadania.

W tym momencie pojawia się sytuacja zagrożenia: człowiek znajduje się w przestrzeni, która według założeń miała być niedostępna podczas ruchu, a system nie jest w stanie wymusić warunków bezpiecznych.

Zabezpieczenie

nie zostało usunięte.

Zostało obejście wbudowane w proces.

b) Zabezpieczenie, które destabilizuje sekwencję pracy

Każda funkcja bezpieczeństwa wprowadza warunki logiczne:

- zatrzymanie przy naruszeniu,

- blokadę startu,

- reset,

- potwierdzenie warunków początkowych.

Jeżeli sekwencja powrotu do pracy jest zbyt złożona, nielogiczna albo nieczytelna, rośnie prawdopodobieństwo działań wykonywanych poza założonym scenariuszem.

Przykładowo:

- reset wykonywany bez wizualnej kontroli strefy,

- ponowne uruchomienie przy obecności ruchów resztkowych,

- ingerencja w trybie serwisowym bez pełnej dezaktywacji energii.

Każdy z tych przypadków jest sytuacją zagrożenia: człowiek znajduje się w przestrzeni oddziaływania zagrożenia przy niespełnionych warunkach bezpieczeństwa.

Z punktu

widzenia oceny ryzyka to nie jest „błąd użytkownika”.

To jest brak analizy, w jaki sposób środek ochronny zmienił dynamikę układu.

c) Konflikt między bezpieczeństwem a ergonomią

Jeżeli środek ochronny:

- ogranicza widoczność strefy roboczej,

- wymusza nienaturalne pozycje ciała,

- zwiększa obciążenie fizyczne,

- wydłuża czas cyklu w sposób istotny operacyjnie,

to zwiększa prawdopodobieństwo niepożądanych zachowań.

A zwiększenie prawdopodobieństwa jest jednym z dwóch elementów definicji ryzyka.

W praktyce wygląda to tak:

Projekt

zakłada bezpieczny dostęp przy zamkniętej osłonie.

Operator, aby widzieć detal, pochyla się i wsuwa rękę pod dolną krawędź.

Zabezpieczenie fizycznie istnieje.

Sytuacja zagrożenia nadal powstaje.

Zabezpieczenie

nie wyeliminowało ryzyka.

Zmieniło jego konfigurację.

4. Liniowe myślenie kontra systemowa analiza

Wszystkie opisane przypadki mają wspólną przyczynę: liniowe podejście do redukcji ryzyka.

Zagrożenie → środek ochronny → problem rozwiązany.

Tymczasem każda zmiana konstrukcyjna w systemie technicznym powinna być traktowana jak nowa konfiguracja układu.

Nowa konfiguracja oznacza:

- nowe warunki pracy,

- nowe punkty dostępu,

- nowe trajektorie ruchu,

- nowe scenariusze zakłóceniowe,

- nowe sytuacje zagrożenia.

Jeżeli projekt nie wraca do identyfikacji zagrożeń po wprowadzeniu środka ochronnego, analiza jest niepełna — nawet jeśli dokumentacja wygląda poprawnie.

I to jest kluczowa różnica między „posiadaniem zabezpieczenia” a rzeczywistą redukcją ryzyka.

5. Dlaczego rozwiązania bezpieczne same w sobie są stabilniejsze

Jeżeli spojrzeć chłodno na strukturę błędów projektowych, widać wyraźną prawidłowość: najwięcej problemów powstaje wtedy, gdy bezpieczeństwo jest „dokładane”, a nie wbudowane.

Rozwiązania konstrukcyjne bezpieczne same w sobie działają inaczej niż środki ochronne. One nie ograniczają dostępu do zagrożenia. One redukują albo eliminują samo zagrożenie u źródła.

Przykłady są proste:

- zmniejszenie energii kinetycznej poprzez ograniczenie prędkości lub masy,

- ograniczenie momentu obrotowego do poziomu bezpiecznego przy kolizji,

- zmniejszenie siły docisku,

- zaokrąglenie krawędzi zamiast ich osłaniania,

- zmiana geometrii eliminująca punkt zgniotu,

- zastosowanie napędu o kontrolowanej charakterystyce zatrzymania.

W takich przypadkach ryzyko maleje, bo maleje energia dostępna w sytuacji niebezpiecznej albo znika mechanizm jej uwolnienia.

To jest jakościowo inna redukcja niż wstawienie bariery.

Jeżeli

zmniejszasz prędkość, redukujesz energię dla każdego scenariusza.

Jeżeli zmniejszasz siłę, redukujesz ciężkość potencjalnej szkody.

Jeżeli eliminujesz punkt zgniotu w geometrii, przestaje istnieć konkretny

mechanizm powstawania szkody.

W wielu przypadkach nie potrzebujesz wtedy „budować” bezpieczeństwa na dodatkowej logice sterowania, resetach i złożonych sekwencjach. Ryzyko spada strukturalnie.

Dlatego te rozwiązania są z natury bardziej stabilne.

6. Czy rozwiązania bezpieczne same w sobie mogą tworzyć nowe sytuacje zagrożenia?

Mogą. Ale mechanizm jest inny — i zwykle rzadszy.

Przykład: redukcja prędkości lub siły w procesie, która powoduje większą liczbę zakłóceń (poślizgi, przemieszczenia detalu, częstsze zacięcia). W efekcie rośnie liczba interwencji ręcznych. A wzrost liczby interwencji to wzrost liczby momentów, w których człowiek wchodzi w strefy oddziaływania zagrożeń — czyli powstają nowe sytuacje zagrożenia.

To nie jest

bezpośredni „skutek uboczny” konstrukcji.

To skutek zmiany stabilności procesu i częstotliwości ingerencji.

Różnica polega jednak na tym, że w rozwiązaniach bezpiecznych samych w sobie zmiana dotyczy źródła energii lub geometrii, a nie samego dostępu. Dlatego liczba nowych sytuacji zagrożenia jest zazwyczaj mniejsza niż przy środkach dokładanych wtórnie.

7. Fundamentalna różnica

Środek

ochronny mówi:

„Zagrożenie istnieje, ograniczymy do niego dostęp.”

Rozwiązanie

bezpieczne samo w sobie mówi:

„Zagrożenie zmienimy albo wyeliminujemy.”

Pierwsze

podejście buduje warunki.

Drugie zmienia fizykę układu.

Dlatego w praktyce projektowej najbezpieczniej jest rozpocząć od redukcji energii, zmiany geometrii i eliminacji mechanizmu zagrożenia, a dopiero potem — jeżeli to konieczne — sięgać po środki techniczne i uzupełniające.

To nie jest

kwestia filozofii.

To kwestia stabilności.

8. Nowe zagrożenia są elementem procesu. Nie wolno ich ignorować.

Cały problem z tzw. „ryzykami wtórnymi” polega na tym, że są traktowane jak coś nieistotnego. Jak drobna niedogodność po wprowadzeniu zabezpieczenia. Jak coś, co można „doprecyzować później”.

Tymczasem z

punktu widzenia metody oceny ryzyka to nie jest detal.

To jest krytyczny moment procesu.

Każde wprowadzenie środka ochronnego zmienia konfigurację układu. A zmiana konfiguracji oznacza możliwość powstania nowych sytuacji zagrożenia.

Jeżeli po redukcji ryzyka nie wracamy do identyfikacji zagrożeń, proces jest przerwany. Nie jest zakończony — jest niedomknięty.

W praktyce to właśnie w tym miejscu powstaje luka: zagrożenie A zostało formalnie zredukowane, ale pojawiło się zagrożenie B — mniej oczywiste, trudniejsze do zauważenia, często związane z obsługą, resetem, dostępem i dynamiką zatrzymania.

Ignorowanie tego etapu oznacza, że redukcja ryzyka jest tylko częściowa.

9. Iteracja, której nie da się „przeklikać”

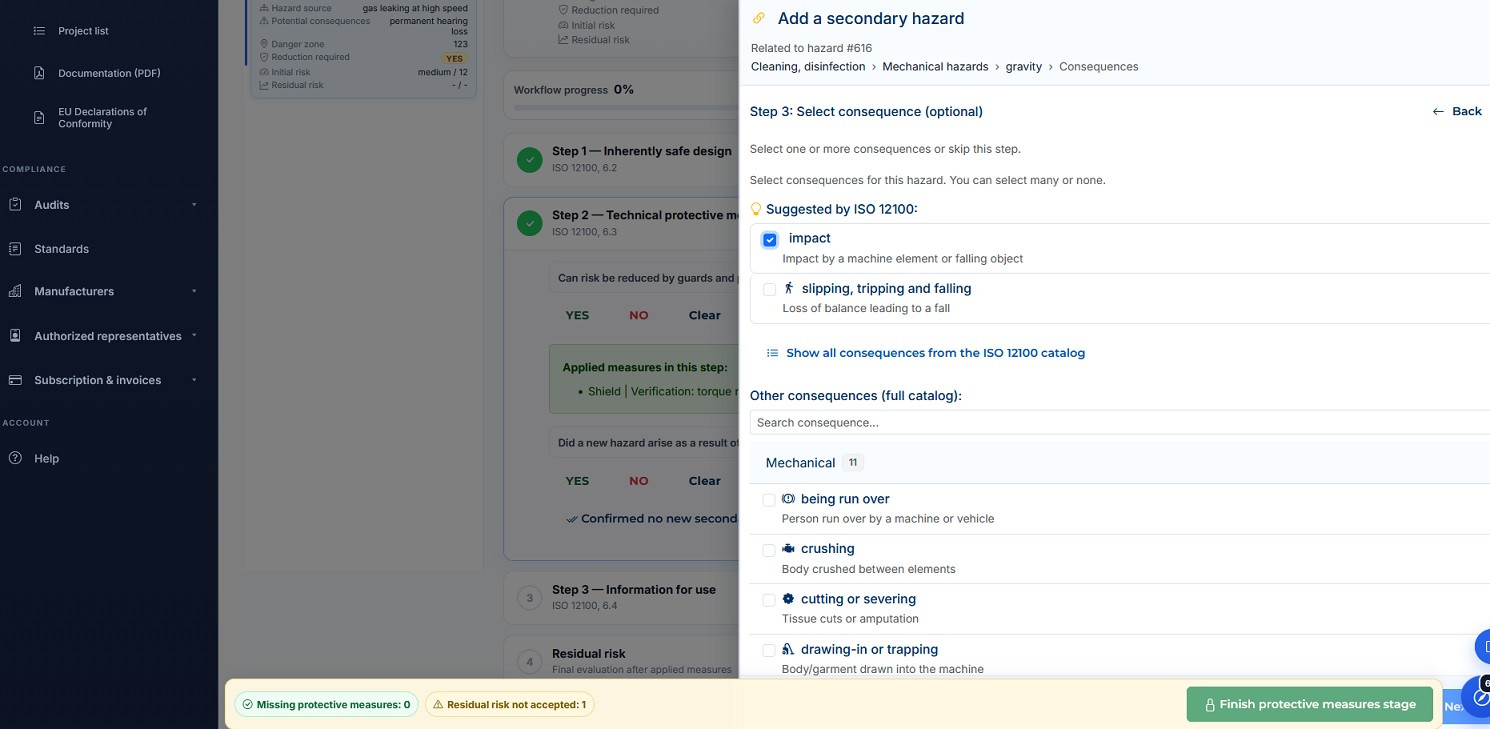

Dlatego w poprawnie zaprojektowanym procesie redukcji ryzyka po każdym etapie powinno paść jedno pytanie:

Czy w wyniku zastosowanych środków ochronnych powstało nowe zagrożenie?

Jeżeli

odpowiedź brzmi „tak” — analiza wraca do identyfikacji.

Jeżeli odpowiedź brzmi „nie” — musi to być świadoma decyzja, a nie domyślne

„dalej”.

I to jest dokładnie mechanizm, który SafetySoftware.eu pilnuje wprost: po etapie redukcji ryzyka system wymusza decyzję, czy zastosowane środki ochronne wygenerowały nowe zagrożenia. Nie pozwala przejść dalej bez zajęcia stanowiska.

To nie jest

funkcja kosmetyczna.

To zabezpieczenie procesu przed liniowym uproszczeniem.

Bo

największe błędy nie wynikają z braku zabezpieczeń.

Wynikają z braku iteracji.

A bezpieczeństwo maszyn zaczyna się dokładnie tam, gdzie kończy się myślenie: „dodaliśmy zabezpieczenie, więc jesteśmy bezpieczni”.